Ce nouveau modèle peut analyser du texte et des images, facilitant le diagnostic d’un grand nombre de maladies. Et sa petite taille le rend beaucoup plus facile d’utilisation.

L’intelligence artificielle (IA) est devenue incontournable en santé, notamment pour le diagnostic. L’IA est déjà une grande alliée des médecins pour repérer le cancer du sein et ceux de la peau, entre autres. Mais ces modèles informatiques sont souvent beaucoup trop spécialisés, difficilement adaptables à d’autres maladies. Toutefois, l’arrivée de nouvelles IA dites de modèles de fondation pourrait changer la donne.

Ces modèles sont entrainés avec une grande variété de données, ce qui les rend très versatiles à l’image de ChatGPT et les autres grands modèles de langage.

Des chercheurs de l’Université Lehigh, de l’Hôpital général de Massachusetts et de l’Université de Harvard (États-Unis) ont créé BiomedGPT, un modèle de fondation entrainé exclusivement avec des données médicales, qui permet de diagnostiquer avec précision un grand nombre de maladies. Les scientifiques l’ont présenté dans la revue Nature Medicine.

Une IA faite sur mesure

ChatGPT, Llama, Gemini… Toutes ces IA sont très puissantes grâce à la quantité d’informations qu’elles ont analysées. Pourtant, elles ne sont pas très fiables en ce qui concerne la médecine. « Elles n’ont pas accès à beaucoup de données médicales, car la plupart ne sont pas publiées sur internet pour protéger la vie privée des patients, nous explique Lichao Sun, professeur de sciences informatiques à l’Université Lehigh et créateur de BiomedGPT. En conséquence, elles n’ont pas forcément de bons résultats en diagnostic médical.”

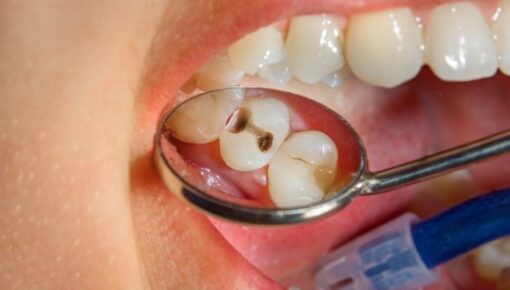

Son modèle est au contraire entrainé uniquement avec des données médicales, dont près de 600.000 images médicales ainsi que près de 200 millions de phrases médicales à l’écrit.

Ce qui semble énorme, mais ce n’est pourtant rien à côté de la quantité presque infinie que ChatGPT et d’autres modèles de langage ont ingurgité en analysant tout ce qu’ils pouvaient trouver sur internet. En conséquence, BiomedGPT est beaucoup plus petit, mais bien plus précis. « Et en plus les données restent sur place, on n’a pas à les envoyer à un serveur extérieur comme ça serait le cas si on utilisait ChatGPT, poursuit-il. Les hôpitaux veulent pouvoir traiter leurs données médicales de façon autonome. La seule façon d’y parvenir était de créer et d’entrainer un modèle qui leur est propre. »

Petite taille, mais grande précision

Certains grands modèles de langage ont été conçus spécifiquement pour la médecine. C’est le cas notamment de Med-PaLM, développé par Google. Sa version multimodale analyse du texte, mais aussi des images, et sa version la plus robuste compte 562 milliards de paramètres ! BiomedGPT est 3.000 fois plus petite, mais fait cependant tout aussi bien. Les chercheurs ont testé leur modèle sur 25 tâches différentes, y compris l’analyse de radiologies médicales, et ses résultats étaient excellents dans la majorité d’entre elles. Et il s’en sortait aussi bien que les vrais experts dans l’écriture de rapports médicaux.

Un modèle facilement installable partout

« Le modèle a été évalué sur des données de l’Hôpital général de Massachusetts avec de bons résultats, confirme Xiang Li, professeur de radiologie à cet hôpital et à l’Université de Harvard. Nous examinons maintenant comment il pourrait être intégré dans le fonctionnement de l’hôpital, ce qui sera facilité par sa petite taille. »

Car sa légèreté permet de l’installer sur des petits ordinateurs, contrairement aux grands modèles de langage commerciaux qui nécessitent une connexion internet et d’énormes serveurs informatiques. « Cela permettra par exemple de l’installer sur les équipements, comme les machines à ultrasons, poursuit-il. Et on ne dépendra pas d’internet, car une mauvaise connexion peut causer des retards, et en médecine, tout retard peut être grave. »

afp